重要

このページの日本語コンテンツは古くなっている可能性があります。最新の英語版コンテンツをご覧になるには、こちらをクリックしてください。

Azure Data Lake Storage Gen2 Sink Connector for Confluent Cloud¶

注釈

Confluent Platform 用にコネクターをローカルにインストールする場合は、「Azure Data Lake Storage Gen2 Sink Connector for Confluent Platform」を参照してください。

Azure Data Lake Storage Gen2 Sink Connector for Confluent Cloud を使用すると、Avro、JSON スキーマ、Protobuf、JSON(スキーマレス)、または Bytes フォーマットの Apache Kafka® トピックのデータを、Avro、JSON、または Bytes フォーマットで Azure ストレージにエクスポートできます。構成によっては、Azure Data Lake Storage Gen2(ADLS Gen2)Sink Connector は、生成される Azure Data Lake Storage Gen2 ファイルのコンシューマーに対して "厳密に 1 回" のデリバリーセマンティクスを保証することによってデータをエクスポートできます。

ADLS Gen2 Sink Connector は、定期的に Kafka のデータをポーリングし、データがあれば Azure Data Lake Storage にアップロードします。すべての Kafka パーティションのデータをチャンクに分割する際には、パーティショナーが使用されます。データの各チャンクは、Azure Data Lake Storage Gen2 ファイルとして存在します。キー名には、そのデータチャンクのトピック、Kafka パーティション、開始オフセットがエンコードされます。構成でパーティショナーを指定しなかった場合は、Kafka のパーティショニングを維持するデフォルトのパーティショナーが使用されます。各データチャンクのサイズは、Azure Data Lake Storage に書き込まれるレコード件数およびスキーマの互換性によって決まります。

機能¶

Azure Data Lake Storage Gen2 (ADLS Gen2) Sink Connector には、以下の機能があります。

「厳密に 1 回」のデリバリー: 決定的パーティショナーを使用してエクスポートされたレコードは、Azure Data Lake Storage の結果整合性にかかわらず、「厳密に 1 回」のセマンティクスで送達されます。

スキーマありまたはスキーマなしのデータフォーマット: このコネクターは、Avro、JSON スキーマ、Protobuf、JSON(スキーマレス)の入力データフォーマットおよび Avro、Parquet、JSON、および Bytes の出力フォーマットをサポートします。スキーマレジストリ ベースのフォーマット(Avro、JSON スキーマ、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

スキーマの進化:

schema.compatibilityはNONEに設定されます。スケジュールによるローテーションとローテーション間隔: コネクターは、スケジュールされた一定間隔で、ファイルをクローズしてストレージにアップロードすることができます。詳細については、「スケジュールによるローテーション」を参照してください。

時間ベースのパーティショナー: このコネクターは、Kafka クラスの

TimeStampに基づいたTimeBasedPartitionerクラスをサポートします。時間ベースのパーティショニングの選択肢は、日次または毎時です。Flush size : デフォルト値は 1000 です。この値は、必要に応じて増やすことができます。Confluent Cloud 専用クラスター を実行する場合は、この値を下げることができます(最小値 1)。専用ではないクラスターの最小値は 1000 です。

どのような状況でレコードがストレージにフラッシュされるかを説明するために、以下に例を示します。

デフォルト設定の 1000 を使用していて、トピックには 6 つのパーティションがあります。1000 件を超えるレコードが各パーティションに存在するようになると、ストレージでのファイルの作成が開始されます。

デフォルト設定の 1000 を使用していて、パーティショナーが "毎時" に設定されています。午後 2 時から午後 3 時までの間に 1 つのパーティションに 500 件のレコードが到達しました。午後 3 時にさらに 5 件のレコードがそのパーティションに到達しました。午後 3 時のストレージには、500 件のレコードが格納されます。

注釈

rotate.schedule.interval.msプロパティとrotate.interval.msプロパティをflush.sizeと一緒に使用して、ストレージにファイルを作成する条件を指定できます。これらのパラメーターが有効になると、最初に満たされた条件に基づいてファイルが保管されます。たとえば、トピックのパーティションが 1 つあるとします。

flush.size=1000とrotate.schedule.interval.ms=600000(10 分)を設定します。12:01 から 12:10 までの間にこのトピックパーティションに 500 件のレコードが到達しました。12:11 から 12:20 までの間にさらに 500 件のレコードが到達しました。それぞれ 500 件のレコードが入った 2 つのファイルがストレージバケットに作成されます。これは、flush.size=1000条件が満たされる前に、10 分のrotate.schedule.interval.ms条件が作動したからです。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

制限¶

以下の情報を確認してください。

- コネクターの制限事項については、Azure Data Lake Storage Gen2 Sink Connector の制限事項を参照してください。

- 1 つ以上の Single Message Transforms(SMT)を使用する場合は、「SMT の制限」を参照してください。

- Confluent Cloud Schema Registry を使用する場合は、「スキーマレジストリ Enabled Environments」を参照してください。

クイックスタート¶

このクイックスタートを使用して、ADLS Gen2 Sink Connector の利用を開始することができます。このクイックスタートでは、コネクターを選択し、Azure ストレージにイベントをストリーミングするようにコネクターを構成するための基本的な方法について説明します。

- 前提条件

- Microsoft Azure 上の Confluent Cloud クラスターへのアクセスを許可されていること。

- Confluent CLI がインストールされ、クラスター用に構成されていること。「Confluent CLI のインストール」を参照してください。

- スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

- Azure Data Lake Storage は、Confluent Cloud クラスターと同じリージョンに存在している必要があります。別のリージョンを使用する場合、追加のデータ転送料金が発生する可能性があることに注意してください。Confluent Cloud と Azure Data Lake Storage を異なるリージョンで使用する必要がある場合は、Confluent サポート にお問い合わせください。

- このコネクターでは、パブリックインバウンドトラフィックアクセス(

0.0.0.0/0)を許可する必要があります。ストレージアカウントの Firewalls and virtual networks で All networks からのアクセスを追加してください。リソースに対するパブリックインターネットアクセスの詳細については、「Networking and DNS Considerations」を参照してください。 - ストレージアカウントのアクセスキー。

- Kafka クラスターの認証情報。次のいずれかの方法で認証情報を指定できます。

- 既存の サービスアカウント のリソース ID を入力する。

- コネクター用の Confluent Cloud サービスアカウント を作成します。「サービスアカウント」のドキュメントで、必要な ACL エントリを確認してください。一部のコネクターには固有の ACL 要件があります。

- Confluent Cloud の API キーとシークレットを作成する。キーとシークレットを作成するには、confluent api-key create を使用するか、コネクターのセットアップ時に Cloud Console で直接 API キーとシークレットを自動生成します。

注意

kafka-connect-storage-common を使用してスキーマレコードとスキーマレスレコードをストレージに混在させることはできません。このようにするとランタイム例外が発生します。このコネクターの セルフマネージド型 バージョンを使用する場合は、ログファイル (セルフマネージド型コネクターでのみ使用可能です)を参照すると、この問題が明らかになります。

Confluent Cloud Console の使用¶

ステップ 1: Confluent Cloud クラスターを起動します。¶

インストール手順については、「Quick Start for Confluent Cloud」を参照してください。

ステップ 2: コネクターを追加します。¶

左のナビゲーションメニューの Data integration をクリックし、Connectors をクリックします。クラスター内に既にコネクターがある場合は、+ Add connector をクリックします。

ステップ 4: コネクターの詳細情報を入力します。¶

注釈

- すべての 前提条件 を満たしていることを確認してください。

- アスタリスク( * )は必須項目であることを示しています。

Add Azure Data Lake Storage Gen2 Sink Connector 画面で、以下を実行します。

既に Kafka トピックを用意している場合は、Topics リストから接続するトピックを選択します。

新しいトピックを作成するには、+Add new topic をクリックします。

- Kafka Cluster credentials で Kafka クラスターの認証情報の指定方法を選択します。以下のいずれかのオプションを選択できます。

- Global Access: コネクターは、ユーザーがアクセス権限を持つすべての対象にアクセスできます。グローバルアクセスの場合、コネクターのアクセス権限は、ユーザーのアカウントにリンクされます。このオプションは本稼働環境では推奨されません。

- Granular access: コネクターのアクセスが制限されます。コネクターのアクセス権限は サービスアカウント から制御できます。本稼働環境にはこのオプションをお勧めします。

- Use an existing API key: 保存済みの API キーおよびシークレット部分を入力できます。API キーとシークレットを入力するか Cloud Console でこれらを生成することもできます。

- Continue をクリックします。

- Azure Data Lake Storage の詳細情報を指定します。

- Azure Data Lake Storage Gen2 Account Name: ストレージアカウントのアカウント名。3 ~ 23 文字の英数字で指定する必要があります。

- Azure Data Lake Storage Gen2 Account Key: ストレージアカウントのアクセスキー。

- Client ID: Azure Active Directory の構成から取得した、クライアントのクライアント ID(GUID)。

- Client Key: クライアントのシークレットキー。

- Azure Token Endpoint: ユーザーのディレクトリに関連付けられている OAuth 2.0 トークンエンドポイント(Active Directory の構成から取得)。

- Continue をクリックします。

注釈

Cloud Console に表示されない構成プロパティでは、デフォルト値が使用されます。デフォルト値とプロパティ定義については、「Azure Data Lake Storage Gen2 Sink Connector 構成プロパティ」を参照してください。

Input Kafka record value で、Kafka 入力レコード値のフォーマット(Kafka トピックから送られるデータ)を AVRO、JSON_SR(JSON スキーマ)、PROTOBUF、JSON(スキーマレス)、または BYTES から選択します。スキーマベースのメッセージフォーマット(AVRO、JSON_SR、PROTOBUF など)を使用するには、有効なスキーマが Schema Registry に存在する必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

注釈

このコネクターでは、JSON フォーマットで入力して AVRO フォーマットで出力することはできません。

Output Kafka record value で、Kafka 出力レコード値のフォーマット(コネクターから送られるデータ)を AVRO、PARQUET、JSON、または BYTES から選択します。スキーマベースのメッセージフォーマット(AVRO など)を使用するには、有効なスキーマが Schema Registry に存在する必要があります。

注釈

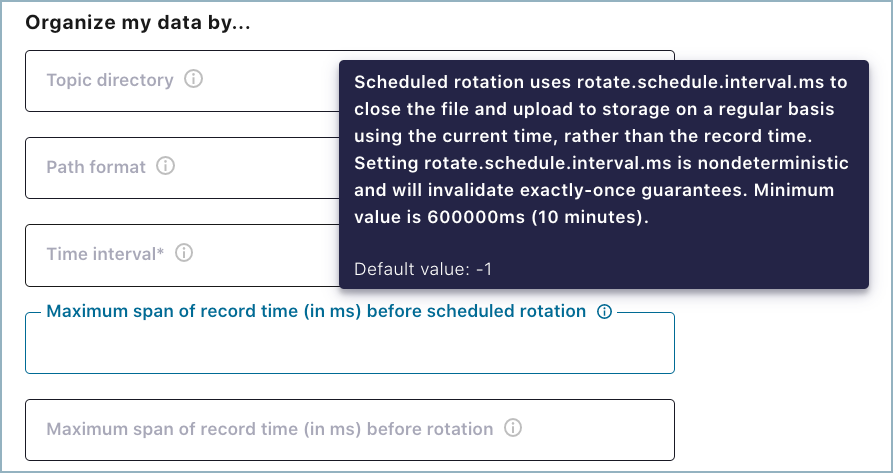

以下の Topic directory、Path format、 Time interval の各プロパティを使用して、S3 に格納するデータのディレクトリ構造するのに使用できます。例: Time interval を

Hourly、Topics directory をjson_logs/hourly、Path format を'dt'=YYYY-MM-dd/'hr'=HHに設定します。この場合、ディレクトリ構造は、//<bucket-name>/json_logs/hourly/<Topic-Name>/dt=2020-02-06/hr=09/<files>になります。Time interval で、メッセージをバケットに分ける時間間隔を入力します。たとえば、

HOURLYを選択すると、1 時間ごとに、メッセージがフォルダーに分けられてデータがバケットにストリーミングされます。Flush size に入力します。この値のデフォルトは 1000 です。デフォルト値は増やす(専用クラスターを実行する場合は減らす)ことができます。熟練したユーザーであれば、以下のドロップダウンをクリックして、ストレージの詳細情報を定義できます。

Show advanced configurations

Parquet Compression Codec (省略可): Azure に書き込む parquet ファイルで使用する圧縮タイプ。値には

none、gzip、またはsnappyを設定できます。Maximum span of record time (in ms) before scheduled rotation: スケジュールによるローテーションでは、

rotate.schedule.interval.msを使用して、定期的にファイルを閉じ、ストレージにアップロードします。その際、レコードの時刻ではなく、現在時刻が使用されます。rotate.schedule.interval.msの設定は非決定的であり、厳密に 1 回の保証は無効になります。最小値は 60000 ミリ秒(10 分)です。Topic directory (省略可): 取り込んだデータが保管される最上位ディレクトリ。

Maximum span of record time (in ms) before rotation: ファイルを開いてレコードを書き込みできる状態にしておく期間の最大値(ミリ秒)を指定できます。

rotate.interval.msを使用する場合、ファイルの期間は、ファイルに追加された最初のレコードのタイムスタンプから開始します。それ以降に到着したレコードのタイムスタンプが、最初のファイルのタイムスタンプに基づいて決められた期間内に収まっていない場合、コネクターはファイルを閉じてストレージにアップロードします。最小値は 600000 ミリ秒(10 分)です。スケジュールによるローテーション のプロパティの詳細については、「スケジュールによるローテーション」を参照してください。Path format (省略可): TimeBasedPartitioner でパーティション分割を行う場合に、この構成を使用して、データディレクトリのフォーマットを設定します。この構成で設定したフォーマットに従って、UNIX のタイムスタンプが有効なディレクトリ文字列に変換されます。

https://<storage-account-name>.blob.core.windows.net/<container-name>/json_logs/daily/<Topic-Name>/dt=2020-02-06/hr=09/<files>のようにファイルを編成するには、プロパティtopics.dir=json_logs/dailyおよびtime.interval=HOURLYを使用します。Timestamp field name (省略可): タイムスタンプとして使用するレコードフィールドです。これが時間ベースパーティショナーで使用されます。使用しない場合は、Kafka レコードを Kafka ブローカーが生成または格納したタイムスタンプがデフォルトとして使用されます。

Timezone (省略可): 有効なタイムゾーン を使用します。使用しない場合は、

UTCがデフォルト設定されます。Locale (省略可): 日付および時刻のフォーマット設定に使用されます。たとえば、英語(米国)の場合は

en-US、英語(英国)の場合はen-GB、英語(インド)の場合はen-IN、フランス語(フランス)の場合はfr-FRを使用できます。デフォルトはenです。ロケール ID のリストについては、『Java のロケール』を参照してください。

変換と述語については、Single Message Transforms(SMT) のドキュメントを参照してください。このコネクターでサポートされていない SMT のリストについては、「サポートされない変換」を参照してください。

Continue をクリックします。

選択するトピックのパーティション数に基づいて、推奨タスク数が表示されます。

- 推奨されたタスク数を変更するには、Tasks フィールドに、コネクターで使用する タスク の数を入力します。

- Continue をクリックします。

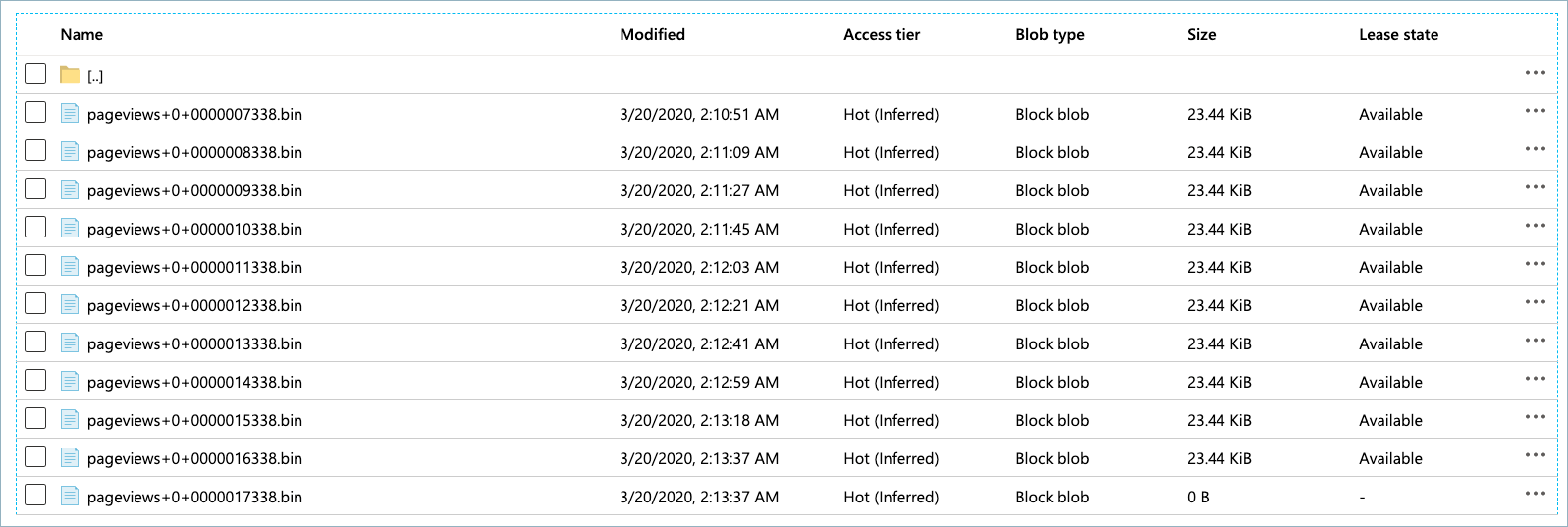

ステップ 5: Azure ストレージコンテナーを確認します。¶

Azure ポータルで、Azure ストレージアカウントに移動します。

メッセージが表示されるまで、各フォルダーを開いていきます。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

ちなみに

コネクターを起動すると、デッドレターキューのトピックが自動的に生成されます。詳細については、「Confluent Cloud デッドレターキュー」を参照してください。

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。

Confluent CLI を使用する場合¶

以下の手順に従うと、Confluent CLI を使用してコネクターをセットアップし、実行できます。

注釈

- すべての 前提条件 を満たしていることを確認してください。

- コマンド例では Confluent CLI バージョン 2 を使用しています。詳細については、「Confluent CLI v2 への移行 <https://docs.confluent.io/confluent-cli/current/migrate.html#cli-migrate>`__」を参照してください。

ステップ 2: コネクターの必須の構成プロパティを表示します。¶

以下のコマンドを実行して、コネクターの必須プロパティを表示します。

confluent connect plugin describe <connector-catalog-name>

例:

confluent connect plugin describe AzureDataLakeGen2Sink

出力例:

Following are the required configs:

connector.class: AzureDataLakeGen2Sink

name

kafka.auth.mode

kafka.api.key

kafka.api.secret

topics

input.data.format

azure.datalake.gen2.account.name

azure.datalake.gen2.access.key

output.data.format

time.interval

tasks.max

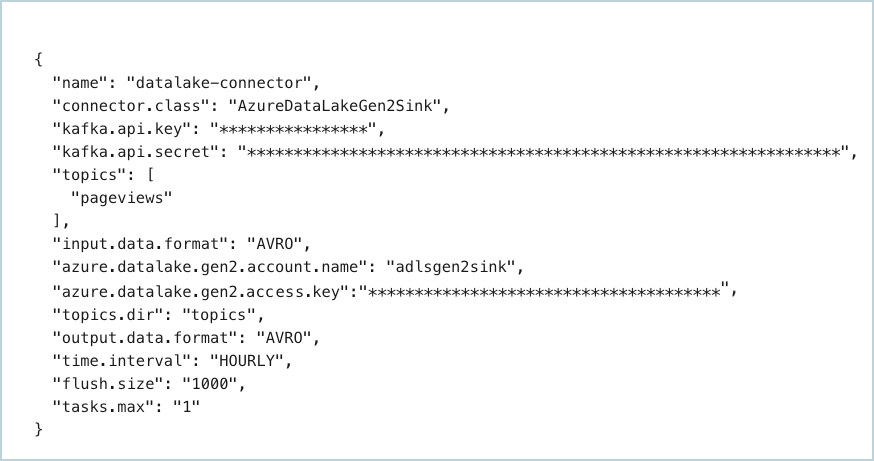

ステップ 3: コネクターの構成ファイルを作成します。¶

コネクター構成プロパティを含む JSON ファイルを作成します。以下の例は、コネクターの必須プロパティを示しています。

{

"name": "adls-sink-connector",

"connector.class": "AzureDataLakeGen2Sink",

"kafka.auth.mode": "KAFKA_API_KEY",

"kafka.api.key": "<my-kafka-api-key>",

"kafka.api.secret": "<my-kafka-api-secret>",

"topics": "pageviews",

"input.data.format": "AVRO",

"azure.datalake.gen2.account.name": "<account-name>",

"azure.datalake.gen2.access.key": "<access-key>",

"topics.dir": "topics",

"output.data.format": "AVRO",

"time.interval": "HOURLY",

"flush.size": "1000",

"tasks.max": "1"

}

以下のプロパティ定義に注意してください。

"name": 新しいコネクターの名前を設定します。"connector.class": コネクターのプラグイン名を指定します。

"kafka.auth.mode": 使用するコネクターの認証モードを指定します。オプションはSERVICE_ACCOUNTまたはKAFKA_API_KEY(デフォルト)です。API キーとシークレットを使用するには、構成プロパティkafka.api.keyとkafka.api.secretを構成例(前述)のように指定します。サービスアカウント を使用するには、プロパティkafka.service.account.id=<service-account-resource-ID>に リソース ID を指定します。使用できるサービスアカウントのリソース ID のリストを表示するには、次のコマンドを使用します。confluent iam service-account list

例:

confluent iam service-account list Id | Resource ID | Name | Description +---------+-------------+-------------------+------------------- 123456 | sa-l1r23m | sa-1 | Service account 1 789101 | sa-l4d56p | sa-2 | Service account 2

"topics": 特定のトピック名を指定するか、複数のトピック名をコンマ区切りにしたリストを指定します。"input.data.format": Kafka 入力レコード値のフォーマットを設定します。指定可能なエントリは、AVRO、JSON_SR、PROTOBUF、JSON、または BYTES です。スキーマベースのメッセージフォーマット(たとえば、Avro、JSON_SR(JSON スキーマ)、および Protobuf)を使用するには、Confluent Cloud Schema Registry を構成しておく必要があります。注釈

このコネクターでは、JSON フォーマットで入力して AVRO フォーマットで出力することはできません。

"topics.dir": 上の例では、デフォルトの入力値topicsが示されています。この例では、topics/pageviewsというディレクトリ階層が作成されます。Kafka トピックごとに、Kafka トピック名に基づいたサブディレクトリが別個に作成されます。topics.dirの先頭を/にすることはできません。"output.data.format": Kafka 出力レコード値のフォーマット(コネクターから送られるデータ)を設定します。指定可能なエントリは、AVRO、PARQUET、JSON、または BYTES です。スキーマベースの出力フォーマット(Avro など)を使用するには、Confluent Cloud Schema Registry を構成しておく必要があります。(省略可)``flush.size``: デフォルト値は 1000 です。この値は、必要に応じて増やすことができます。Confluent Cloud 専用クラスター を実行する場合は、この値を下げることができます(最小値 1)。専用ではないクラスターの最小値は 1000 です。

どのような状況でレコードがストレージにフラッシュされるかを説明するために、以下に例を示します。

デフォルト設定の 1000 を使用していて、トピックには 6 つのパーティションがあります。1000 件を超えるレコードが各パーティションに存在するようになると、ストレージでのファイルの作成が開始されます。

デフォルト設定の 1000 を使用していて、パーティショナーが "毎時" に設定されています。午後 2 時から午後 3 時までの間に 1 つのパーティションに 500 件のレコードが到達しました。午後 3 時にさらに 5 件のレコードがそのパーティションに到達しました。午後 3 時のストレージには、500 件のレコードが格納されます。

注釈

rotate.schedule.interval.msプロパティとrotate.interval.msプロパティをflush.sizeと一緒に使用して、ストレージにファイルを作成する条件を指定できます。これらのパラメーターが有効になると、最初に満たされた条件に基づいてファイルが保管されます。たとえば、トピックのパーティションが 1 つあるとします。

flush.size=1000とrotate.schedule.interval.ms=600000(10 分)を設定します。12:01 から 12:10 までの間にこのトピックパーティションに 500 件のレコードが到達しました。12:11 から 12:20 までの間にさらに 500 件のレコードが到達しました。それぞれ 500 件のレコードが入った 2 つのファイルがストレージバケットに作成されます。これは、flush.size=1000条件が満たされる前に、10 分のrotate.schedule.interval.ms条件が作動したからです。

"time.interval": メッセージを GCS バケットに分ける方法を設定します。入力できる値は、DAILY または HOURLY です。

ちなみに

上記の time.interval プロパティと、オプションのプロパティ topics.dir および path.format を使用して、S3 に格納するデータのディレクトリ構造を作成できます。例: "time.interval" : "HOURLY"、"topics.dir" : "json_logs/hourly"、"path.format" : "'dt'=YYYY-MM-dd/'hr'=HH" を設定します。この場合、S3 のディレクトリ構造は、s3://<s3-bucket-name>/json_logs/daily/<Topic-Name>/dt=2020-02-06/hr=09/<files> になります。

"topics.dir": これは、S3 に格納するデータに使用する最上位ディレクトリのパスです。使用しない場合は、topicsがデフォルトとして使用されます。""path.format": これによって、S3 に作成される時間ベースのパーティショニングのパスを構成できます。このプロパティでは、UNIX のタイムスタンプが日付フォーマットの文字列に変換されます。このプロパティを使用しない場合は、'year'=YYYY/'month'=MM/'day'=dd/'hour'=HH(time.intervalに Hourly を選択した場合)または'year'=YYYY/'month'=MM/'day'=dd(Daily の時間間隔を選択した場合)がデフォルトとして使用されます。rotate.schedule.interval.msおよびrotate.interval.ms: これらのプロパティの使用方法について詳しくは、「スケジュールによるローテーション」を参照してください。"tasks.max": 使用するコネクタータスクの最大数を入力します。

Single Message Transforms: CLI を使用した SMT の追加の詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。このコネクターでサポートされていない SMT のリストについては、「サポートされない変換」を参照してください。

すべてのプロパティの値と定義については、「構成プロパティ」を参照してください。

ステップ 4: プロパティファイルを読み込み、コネクターを作成します。¶

以下のコマンドを入力して、構成を読み込み、コネクターを起動します。

confluent connect create --config <file-name>.json

例:

confluent connect create --config adls-sink-config.json

出力例:

Created connector adls-sink-connector lcc-ix4dl

ステップ 5: コネクターのステータスを確認します。¶

以下のコマンドを入力して、コネクターのステータスを確認します。

confluent connect list

出力例:

ID | Name | Status | Type

+-----------+---------------------------+---------+------+

lcc-ix4dl | adls-sink-connector | RUNNING | sink

ステップ 6: Azure ストレージコンテナーを確認します。¶

Azure ポータルで、Azure ストレージアカウントに移動します。

メッセージが表示されるまで、各フォルダーを開いていきます。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

ちなみに

コネクターを起動すると、デッドレターキューのトピックが自動的に生成されます。詳細については、「Confluent Cloud デッドレターキュー」を参照してください。

スケジュールによるローテーション¶

ローテーションのスケジュールをセットアップできるように、2 つのオプションのプロパティが用意されています。これらのプロパティは、Cloud Console (以下の画面)と Confluent CLI にあります。

rotate.schedule.interval.ms(スケジュールによるローテーション): このプロパティを使用すると、ファイルを閉じてストレージにアップロードする定期的なスケジュールを構成できます。デフォルト値は-1(無効)です。たとえば、600000 ミリ秒に設定すると、少なくとも 10 分ごとにストレージバケットにファイルが生成されます。rotate.schedule.interval.msは、継続的なデータストリームを必要としません。注釈

rotate.schedule.interval.msプロパティを使用すると、非決定的な環境になるので、"厳密に 1 回" の保証は無効になります。rotate.interval.ms(ローテーションの間隔) : このプロパティを使用すると、追加レコードためにファイルを開いたままにできる最長期間(ミリ秒)を指定できます。このプロパティを使用する場合、ファイルのタイム時間間隔はファイルに追加された最初のレコードのタイムスタンプから開始します。最初のファイルのタイムスタンプから始まる期間に収まっていないタイムスタンプのレコードが到着したときに、コネクターはファイルをクローズしてストレージにアップロードします。最小値は 600000 ミリ秒(10 分)です。このプロパティのデフォルトは、time.intervalプロパティで設定された間隔です。rotate.interval.msは、継続的なデータストリームを必要とします。重要

期間の開始と終了は、ファイルのタイムスタンプによって決まります。そのため、最初のファイルのタイムスタンプから始まる期間に収まっていないタイムスタンプのレコードが到着するまで、ファイルが長時間開いたままになる可能性があります。

構成プロパティ¶

このコネクターでは、以下のコネクター構成プロパティを使用します。

データの取得元とするトピック(Which topics do you want to get data from?)¶

topics特定のトピック名を指定するか、複数のトピック名をコンマ区切りにしたリストを指定します。

- 型: list

- 重要度: 高

入力メッセージ(Input messages)¶

input.data.format入力メッセージフォーマットを設定します。指定可能なエントリは、AVRO、JSON_SR、PROTOBUF、JSON、または BYTES です。スキーマベースのメッセージフォーマット(AVRO、JSON_SR、PROTOBUF など)を使用する場合は、Confluent Cloud Schema Registry を構成しておく必要がある点に注意してください

- 型: string

- 重要度: 高

データへの接続方法(How should we connect to your data?)¶

nameコネクターの名前を設定します。

- 型: string

- 指定可能な値: 最大 64 文字の文字列

- 重要度: 高

Kafka クラスターの認証情報(Kafka Cluster credentials)¶

kafka.auth.modeKafka の認証モード。KAFKA_API_KEY または SERVICE_ACCOUNT を指定できます。デフォルトは KAFKA_API_KEY モードです。

- 型: string

- デフォルト: KAFKA_API_KEY

- 指定可能な値: KAFKA_API_KEY、SERVICE_ACCOUNT

- 重要度: 高

kafka.api.key- 型: password

- 重要度: 高

kafka.service.account.idKafka クラスターとの通信用の API キーを生成するために使用されるサービスアカウント。

- 型: string

- 重要度: 高

kafka.api.secret- 型: password

- 重要度: 高

送信先(Destination)¶

topics.dirTop-level directory where ingested data is stored. The topics.dir entry should not start with /.

- 型: string

- デフォルト: topics

- 重要度: 高

ADLS Gen2 ストレージアカウントへの接続方法(How should we connect to your ADLS Gen2 storage account?)¶

azure.datalake.gen2.account.name3 ~ 23 文字の英数字で指定する必要があります。

- 型: string

- 重要度: 高

azure.datalake.gen2.access.keyストレージアカウント用のアクセスキー。

- 型: password

- 重要度: 高

Active Directory への接続方法(How should we connect to your Active Directory?)¶

azure.datalake.gen2.client.idAzure Active Directory の構成から取得した、クライアントのクライアント ID(GUID)。

- 型: string

- 重要度: 高

azure.datalake.gen2.client.keyクライアントのシークレットキー。

- 型: password

- 重要度: 高

azure.datalake.gen2.token.endpointユーザーのディレクトリに関連付けられている OAuth 2.0 トークンエンドポイント(Active Directory の構成から取得)

- 型: string

- 重要度: 高

出力メッセージ(Output messages)¶

output.data.formatSet the output message format for values. Valid entries are AVRO, JSON, PARQUET or BYTES. Note that you need to have Confluent Cloud Schema Registry configured if using a schema-based message format like AVRO. Note that the output message format defaults to the value in the Input Message Format field. If either PROTOBUF or JSON_SR is selected as the input message format, you should select one explicitly. If no value for this property is provided, the value specified for the 'input.data.format' property is used.

- 型: string

- 重要度: 高

parquet.codecAzure に書き込む parquet ファイルで使用する圧縮タイプ。

- 型: string

- 重要度: 高

データ編成の基準(Organize my data by...)¶

path.formatTimeBasedPartitioner を使用してパーティション分割を行う場合に、この構成を使用して、データディレクトリのフォーマットを設定します。この構成で設定したフォーマットに従って、UNIX のタイムスタンプが有効なディレクトリ文字列に変換されます。https://<storage-account-name>.blob.core.windows.net/<container-name>/json_logs/daily/<Topic-Name>/dt=2020-02-06/hr=09/<files> のようにファイルを編成するには、プロパティ topics.dir=json_logs/daily および time.interval=HOURLY を使用します。

- 型: string

- デフォルト: 'year'=YYYY/'month'=MM/'day'=dd/'hour'=HH

- 重要度: 高

time.intervalストレージに取り込まれた時間に応じた、データのパーティショニング間隔。

- 型: string

- 重要度: 高

rotate.schedule.interval.msスケジュールによるローテーションでは、rotate.schedule.interval.ms を使用して定期的にファイルを閉じ、ストレージにアップロードします。その際、レコードの時刻ではなく、現在時刻が使用されます。rotate.schedule.interval.ms の設定は非決定的であり、"厳密に 1 回" の保証は無効になります。最小値は 600000 ミリ秒(10 分)です。

- 型: int

- デフォルト: -1

- 重要度: 中

rotate.interval.msコネクターのローテーションの間隔では、ファイルを開いてレコードを書き込みできる状態にしておく期間の最大値(ミリ秒)を指定します。つまり、rotate.interval.ms を使用する場合、各ファイルのタイムスタンプはファイルに挿入された最初のレコードのタイムスタンプから開始します。次のレコードのタイムスタンプが最初のレコードのタイムスタンプのファイルの rotate.interval の期間に収まらない場合、コネクターはファイルを閉じて Blob Storage にアップロードします。コネクターで処理するレコードがそれ以上ない場合、次のレコードを処理できるようになるまでの間、コネクターはファイルを開いたままにすることがあります(長時間になる可能性があります)。最小値は 600000 ミリ秒(10 分)です。このプロパティの値が指定されていない場合、'time.interval' プロパティに指定されている値が使用されます。

- 型: int

- 重要度: 高

flush.sizeファイルのコミットを呼び出す前にストレージに書き込まれるレコードの数。

- 型: int

- デフォルト: 1000

- 重要度: 高

timestamp.fieldTimeBasedPartitioner に使用されるタイムスタンプを含むフィールドを設定します

- 型: string

- デフォルト: ""

- 重要度: 高

timezoneTimeBasedPartitioner で使用されるタイムゾーンを設定します。

- 型: string

- デフォルト: UTC

- 重要度: 高

localeTimeBasedPartitioner で使用するロケールを設定します。

- 型: string

- デフォルト: en

- 重要度: 高

value.converter.connect.meta.dataConnect コンバーターの有効化と無効化を切り替えて、メタデータを出力スキーマに追加するかどうかを指定します。

- 型: boolean

- デフォルト: true

- 重要度: 中

このコネクターのタスク数(Number of tasks for this connector)¶

tasks.max- 型: int

- 指定可能な値: [1、…]

- 重要度: 高

次のステップ¶

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。