重要

このページの日本語コンテンツは古くなっている可能性があります。最新の英語版コンテンツをご覧になるには、こちらをクリックしてください。

Salesforce SObject Sink Connector for Confluent Cloud¶

注釈

If you are installing the connector locally for Confluent Platform, see Salesforce SObject Sink Connector for Confluent Platform.

Kafka Connect Salesforce SObject Sink Connector では、Apache Kafka® のトピックから利用可能なデータを使用して、Salesforce SObject 上で CRUD 操作(作成、アップデート、削除、挿入)が実行されます。Salesforce PushTopic Source Connector から作成されたデータで操作を実行できるため、このコネクターは、Salesforce PushTopic Source Connector の逆のものとみなすことができます。

たとえば、2 つの Salesforce.com 組織またはインスタンスとして、インスタンス A とインスタンス B があり、データエンジニアが Salesforce Lead オブジェクトをインスタンス A からインスタンス B に同期するとします。エンジニアは、PushTopic Source Connector を、Salesforce Lead をインスタンス A から単一の Kafka のトピックにストリーミングするよう構成してデプロイできます。一方、SObject Sink Connector は、Lead を Kafka トピックからインスタンス B にストリーミングするように構成できます。構成に応じて、Lead SObject に対するすべての変更を組織間で同期できます。

機能¶

Oracle Database Sink Connector は、次の機能をサポートしています。

少なくとも 1 回のデリバリー: コネクターによって、Kafka のトピックからのレコードが少なくとも 1 回は配信されることが保証されます。

複数のタスクのサポート: このコネクターは、1 つまたは複数のタスクの実行をサポートしています。タスクが多いほどパフォーマンスが向上する可能性があります(複数のタスクを実行するとコンシューマーラグが減少します)。

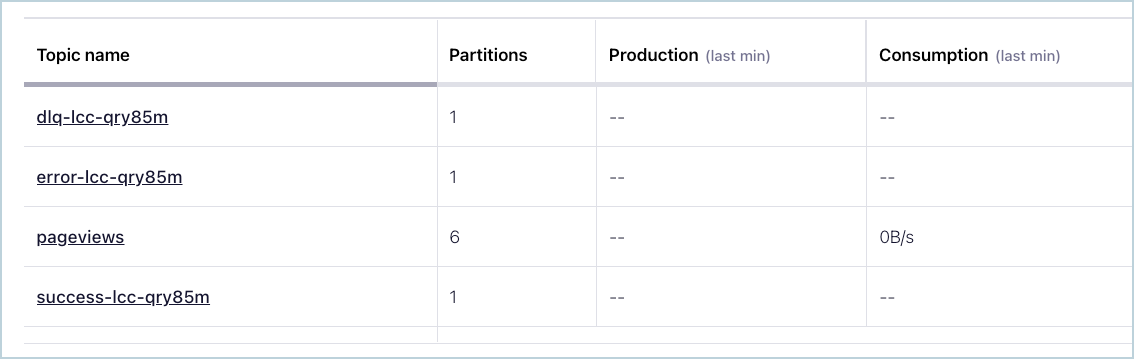

トピックの自動作成: コネクターの起動時に、以下の 3 つのトピックが自動的に作成されます。

- 成功トピック

- エラートピック

- デッドレターキュー(DLQ)トピック

各トピック名にはサフィックスとして、コネクターの論理 ID が付けられます。以下の例では、コネクターのトピックが 3 つと、pageviews という名前の既存の Kafka トピックが 1 つ含まれています。

コネクターのトピック¶

トピックに送信されたレコードが正しいフォーマットではない場合、またはレコード内に重要なフィールドが存在しない場合は、エラートピックにエラーが記録され、コネクターは動作を継続します。

サポートされるデータフォーマット: このコネクターは、Kafka 入力レコード値のフォーマットとして Avro、JSON スキーマ(JSON-SR)、および Protobuf をサポートします。これらの スキーマレジストリ ベースのフォーマットを使用するには、Schema Registry を有効にしておく必要があります。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

制限¶

以下の情報を確認してください。

- コネクターの制限事項については、Salesforce SObject Sink Connector の制限事項を参照してください。

- 1 つ以上の Single Message Transforms(SMT)を使用する場合は、「SMT の制限」を参照してください。

- Confluent Cloud Schema Registry を使用する場合は、「スキーマレジストリ Enabled Environments」を参照してください。

クイックスタート¶

このクイックスタートを使用して、Confluent Cloud Salesforce SObject Sink Connector の利用を開始することができます。このクイックスタートでは、コネクターを選択し、イベントをストリーミングするようにコネクターを構成するための基本的な方法について説明します。

- 前提条件

- アマゾンウェブサービス (AWS)、Microsoft Azure (Azure)、または Google Cloud Platform (GCP)上の Confluent Cloud クラスターへのアクセスを許可されていること。

- コネクターで使用する、認可された Salesforce ユーザーと認証情報。

- Confluent CLI がインストールされ、クラスター用に構成されていること。「Confluent CLI のインストール」を参照してください。

- スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

- シンクコネクターを作成する前に、Confluent Cloud クラスター上にソース Kafka トピックが 1 つ以上存在している必要があります。

Confluent Cloud Console の使用¶

ステップ 1: Confluent Cloud クラスターを起動します。¶

インストール手順については、「Quick Start for Confluent Cloud」を参照してください。

ステップ 2: コネクターを追加します。¶

左のナビゲーションメニューの Data integration をクリックし、Connectors をクリックします。クラスター内に既にコネクターがある場合は、+ Add connector をクリックします。

ステップ 4: コネクターの詳細情報を入力します。¶

注釈

- すべての 前提条件 を満たしていることを確認してください。

- アスタリスク( * )は必須項目であることを示しています。

Add PagerDuty Sink Connector 画面で、以下を実行します。

既に Kafka トピックを用意している場合は、Topics リストから接続するトピックを選択します。

新しいトピックを作成するには、+Add new topic をクリックします。

- Kafka Cluster credentials で Kafka クラスターの認証情報の指定方法を選択します。以下のいずれかのオプションを選択できます。

- Global Access: コネクターは、ユーザーがアクセス権限を持つすべての対象にアクセスできます。グローバルアクセスの場合、コネクターのアクセス権限は、ユーザーのアカウントにリンクされます。このオプションは本稼働環境では推奨されません。

- Granular access: コネクターのアクセスが制限されます。コネクターのアクセス権限は サービスアカウント から制御できます。本稼働環境にはこのオプションをお勧めします。

- Use an existing API key: 保存済みの API キーおよびシークレット部分を入力できます。API キーとシークレットを入力するか Cloud Console でこれらを生成することもできます。

- Continue をクリックします。

- 以下の Salesforce 接続の詳細情報を入力します。

- Salesforce consumer key: OAuth アプリケーションのコンシューマーキー。

- Salesforce consumer secret: OAuth アプリケーションのコンシューマーシークレット。

- Salesforce SObject Name: 書き込み先の Salesforce SObject。

- Salesforce instance: 使用する Salesforce エンドポイントの URL。デフォルトは https://login.salesforce.com です。これにより、コネクターは、認証応答の中で指定されたエンドポイントを使用します。

- Salesforce password: コネクターで使用される Salesforce パスワード。

- Salesforce password token: ユーザー名に関連付けられた Salesforce セキュリティトークン。

- Continue をクリックします。

注釈

Cloud Console に表示されない構成プロパティでは、デフォルト値が使用されます。すべてのプロパティの値と定義については、「構成プロパティ」を参照してください。

Input Kafka record value で、Kafka 入力レコード値のフォーマット(Kafka トピックから送られるデータ)を AVRO、JSON_SR、または PROTOBUF から選択します。スキーマベースのメッセージフォーマット(Avro、JSON スキーマ、Protobuf など)を使用するには、有効なスキーマが Schema Registry に存在する必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

Show advanced configurations

Salesforce SObject Override: If set to

true, the connector overrides the Kafka SObject source record event type (create, update, or delete) using the operation specified in the SObject Override Operation property.SObject Override Operation: Used when Salesforce SObject Override is set to

true. This sets the override operation to perform on the SObject. Options are:insert,update,upsert, anddelete. Defaults toinsert.SObject Ignore Fields: コネクターが Salesforce にレコードをプッシュする際に無視するフィールドのコンマ区切りのリスト。

SObject Ignore Reference Fields: デフォルトは true です。これを設定すると、Salesforce SObject での参照型のフィールドに対する挿入またはアップデート操作ができなくなります。

Salesforce SObject Use Custom Field: SObjects でカスタムの外部 id フィールドを使用するためのフラグ。

Salesforce SObject Custom Field Name: INSERT、UPSERT、DELETE、UDPATE の各操作の REST API 呼び出しを構成するための、SObject 内のカスタムの外部 ID フィールドの名前。

Connection timeout: Salesforce エンドポイントに接続する際の待機時間(ミリ秒)。

Max Retry Time in Milliseconds: Salesforce へのリクエストの実行中にエラーが発生した場合は、この時間(ミリ秒)が経過するまで、コネクターにより再試行されます。デフォルト値は 30000(30 秒)です。最小値は 1 秒です。

Transforms and Predicates: 詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。

すべてのプロパティの値と定義については、「構成プロパティ」を参照してください。

Continue をクリックします。

選択するトピックのパーティション数に基づいて、推奨タスク数が表示されます。

- 推奨されたタスク数を変更するには、Tasks フィールドに、コネクターで使用する タスク の数を入力します。

- Continue をクリックします。

接続の詳細情報を確認します。

Launch をクリックします。

コネクターのステータスが Provisioning から Running に変わります。

ステップ 5: レコードを確認します。¶

レコードがエンドポイントに生成されていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

ちなみに

コネクターを起動すると、デッドレターキューのトピックが自動的に作成されます。詳細については、「Confluent Cloud デッドレターキュー」を参照してください。

Confluent CLI の使用¶

以下の手順に従うと、Confluent CLI を使用してコネクターをセットアップし、実行できます。

注釈

- すべての 前提条件 を満たしていることを確認してください。

- コマンド例では Confluent CLI バージョン 2 を使用しています。詳細については、「Confluent CLI v2 への移行 <https://docs.confluent.io/confluent-cli/current/migrate.html#cli-migrate>`__」を参照してください。

ステップ 2: コネクターの必須の構成プロパティを表示します。¶

以下のコマンドを実行して、コネクターの必須プロパティを表示します。

confluent connect plugin describe <connector-catalog-name>

例:

confluent connect plugin describe SalesforceSObjectSink

出力例:

Following are the required configs:

connector.class: SalesforceSObjectSink

input.data.format

name

kafka.auth.mode

kafka.api.key

kafka.api.secret

salesforce.username

salesforce.password

salesforce.password.token

salesforce.consumer.key

salesforce.consumer.secret

salesforce.object

tasks.max

topics

ステップ 3: コネクターの構成ファイルを作成します。¶

コネクター構成プロパティを含む JSON ファイルを作成します。以下の例は、コネクターの必須プロパティを示しています。

{

"connector.class": "SalesforceSObjectSink",

"input.data.format": "AVRO",

"name": "SalesforceSObjectSinkConnector_0",

"kafka.auth.mode": "KAFKA_API_KEY",

"kafka.api.key": "<my-kafka-api-key>",

"kafka.api.secret": "<my-kafka-api-secret>",

"salesforce.username": "<username>",

"salesforce.password": "<password>",

"salesforce.password.token": "<password-token>",

"salesforce.consumer.key": "<consumer-key>",

"salesforce.consumer.secret": "<consumer-secret>",

"salesforce.object": "<salesforce-SObject>",

"tasks.max": "1",

"topics": "orders",

}

以下のプロパティ定義に注意してください。

"connector.class": コネクターのプラグイン名を指定します。"input.data.format": Kafka 入力レコード値のフォーマット(Kafka トピックから送られるデータ)を設定します。指定可能なエントリは、AVRO、JSON_SR、および PROTOBUF です。スキーマベースのメッセージフォーマット(たとえば、Avro、JSON_SR(JSON スキーマ)、および Protobuf)を使用するには、Confluent Cloud Schema Registry を構成しておく必要があります。"name": 新しいコネクターの名前を設定します。

"kafka.auth.mode": 使用するコネクターの認証モードを指定します。オプションはSERVICE_ACCOUNTまたはKAFKA_API_KEY(デフォルト)です。API キーとシークレットを使用するには、構成プロパティkafka.api.keyとkafka.api.secretを構成例(前述)のように指定します。サービスアカウント を使用するには、プロパティkafka.service.account.id=<service-account-resource-ID>に リソース ID を指定します。使用できるサービスアカウントのリソース ID のリストを表示するには、次のコマンドを使用します。confluent iam service-account list

例:

confluent iam service-account list Id | Resource ID | Name | Description +---------+-------------+-------------------+------------------- 123456 | sa-l1r23m | sa-1 | Service account 1 789101 | sa-l4d56p | sa-2 | Service account 2

salesforce.<>: 必須の Salesforce 接続の詳細情報。Salesforce 認証の詳細とその意味については、『Connected App and OAuth Terminology』を参照してください。"tasks.max": このコネクターで使用できる タスク の最大数を入力します。タスクが多いほどパフォーマンスが向上する可能性があります(複数のタスクを実行するとコンシューマーラグが減少します)。"topics": 特定のトピック名を指定するか、複数のトピック名をコンマ区切りにしたリストを指定します。

Single Message Transforms: CLI を使用する SMT の追加の詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。

すべてのプロパティの値と説明については、「構成プロパティ」を参照してください。

ステップ 4: プロパティファイルを読み込み、コネクターを作成します。¶

以下のコマンドを入力して、構成を読み込み、コネクターを起動します。

confluent connect create --config <file-name>.json

例:

confluent connect create --config salesforce-SObject-sink-config.json

出力例:

Created connector SalesforceSObjectSinkConnector_0 lcc-do6vzd

ステップ 5: コネクターのステータスを確認します。¶

以下のコマンドを入力して、コネクターのステータスを確認します。

confluent connect list

出力例:

ID | Name | Status | Type | Trace

+------------+----------------------------------+---------+------+-------+

lcc-do6vzd | SalesforceSObjectSinkConnector_0 | RUNNING | sink | |

ステップ 6: レコードを確認します。¶

レコードがエンドポイントに取り込まれていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

ちなみに

コネクターを起動すると、デッドレターキューのトピックが自動的に作成されます。詳細については、「Confluent Cloud デッドレターキュー」を参照してください。

構成プロパティ¶

このコネクターでは、以下のコネクター構成プロパティを使用します。

データの取得元とするトピック(Which topics do you want to get data from?)¶

topics特定のトピック名を指定するか、複数のトピック名をコンマ区切りにしたリストを指定します。

- 型: list

- 重要度: 高

入力メッセージ(Input messages)¶

input.data.formatKafka 入力レコード値のフォーマットを設定します。指定可能なエントリは、AVRO、JSON_SR、および PROTOBUF です。Confluent Cloud Schema Registry を構成しておく必要があります。

- 型: string

- 重要度: 高

データへの接続方法(How should we connect to your data?)¶

nameコネクターの名前を設定します。

- 型: string

- 指定可能な値: 最大 64 文字の文字列

- 重要度: 高

Kafka クラスターの認証情報(Kafka Cluster credentials)¶

kafka.auth.modeKafka の認証モード。KAFKA_API_KEY または SERVICE_ACCOUNT を指定できます。デフォルトは KAFKA_API_KEY モードです。

- 型: string

- デフォルト: KAFKA_API_KEY

- 指定可能な値: KAFKA_API_KEY、SERVICE_ACCOUNT

- 重要度: 高

kafka.api.key- 型: password

- 重要度: 高

kafka.service.account.idKafka クラスターとの通信用の API キーを生成するために使用されるサービスアカウント。

- 型: string

- 重要度: 高

kafka.api.secret- 型: password

- 重要度: 高

Salesforce への接続方法(How should we connect to Salesforce?)¶

salesforce.instance使用する Salesforce エンドポイントの URL。デフォルトは https://login.salesforce.com です。これにより、コネクターは、認証応答の中で指定されたエンドポイントを使用します。

- 型: string

- デフォルト: https://login.salesforce.com

- 重要度: 高

salesforce.usernameコネクターで使用される Salesforce ユーザー名。

- 型: string

- 重要度: 高

salesforce.passwordコネクターで使用される Salesforce パスワード。

- 型: password

- 重要度: 高

salesforce.password.tokenユーザー名に関連付けられた Salesforce セキュリティトークン。

- 型: password

- 重要度: 高

salesforce.consumer.keyOAuth アプリケーションのコンシューマーキー。

- 型: password

- 重要度: 高

salesforce.consumer.secretOAuth アプリケーションのコンシューマーシークレット。

- 型: password

- 重要度: 高

salesforce.object書き込み先の Salesforce SObject。

- 型: string

- 重要度: 高

Salesforce SObject プロパティ(Salesforce SObject properties)¶

salesforce.object.override.event.typeSObject override operation フィールドで指定された操作を使用するために、Kafka SObject ソースレコードの EventType(create、update、delete)がオーバーライドされることを示すフラグ。

- 型: boolean

- デフォルト: false

- 重要度: 低

salesforce.sink.object.operationSObject に対して実行する Salesforce シンク操作。insert、update、upsert、delete のいずれかです。デフォルトは insert です。この機能は、

override.event.typeが true の場合に機能します。- 型: string

- デフォルト: insert

- 重要度: 低

salesforce.ignore.fieldsSalesforce にレコードをプッシュする際に無視する、ソースの Kafka レコードからのフィールドのコンマ区切りリスト。

- 型: list

- デフォルト: ""

- 重要度: 低

salesforce.ignore.reference.fieldsSalesforce SObject で参照型のフィールドに対するアップデートまたは挿入を回避するためのフラグ。

- 型: boolean

- デフォルト: false

- 重要度: 低

salesforce.use.custom.id.fieldSObjects でカスタムの外部 id フィールドを使用するためのフラグ。

- 型: boolean

- デフォルト: false

- 重要度: 低

salesforce.custom.id.field.name挿入、アップサート、削除、アップデートの各操作の REST API 呼び出しを構成するための、SObject 内のカスタムの外部 ID フィールドの名前。

- 型: string

- 重要度: 低

接続の詳細(Connection details)¶

connection.timeoutSalesforce ストリーミングエンドポイントに接続する際の待機時間(ミリ秒)。

- 型: long

- デフォルト: 30000

- 重要度: 低

request.max.retries.time.msSalesforce へのリクエストの実行中にエラーが発生した場合は、この時間(ミリ秒)が経過するまで、コネクターにより再試行されます。デフォルト値は 30000(30 秒)です。最小値は 1 秒です。

- 型: long

- デフォルト: 30000(30 秒)

- 指定可能な値: [1000,...,250000]

- 重要度: 低

behavior.on.api.errorsError handling behavior config for any API errors.

- 型: string

- Default: ignore

- 重要度: 低

このコネクターのタスク数(Number of tasks for this connector)¶

tasks.max- 型: int

- 指定可能な値: [1,...]

- 重要度: 高

次のステップ¶

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。