重要

このページの日本語コンテンツは古くなっている可能性があります。最新の英語版コンテンツをご覧になるには、こちらをクリックしてください。

MySQL Source(JDBC)Connector for Confluent Cloud¶

注釈

Confluent Platform 用にコネクターをローカルにインストールする場合は、「JDBC Connector(Source および Sink)for Confluent Platform」を参照してください。

Kafka Connect MySQL Source Connector for Confluent Cloud は、MySQL データベースの既存データのスナップショットを取得し、そのデータに対してそれ以降に発生する行レベルの変更をすべてモニタリングして記録することができます。このコネクターは、Avro、JSON スキーマ、Protobuf、または JSON(スキーマレス)の出力データフォーマットをサポートします。テーブルごとにすべてのイベントが個別の Apache Kafka® トピックに記録されます。そのため、アプリケーションやサービスでイベントを簡単に消費することができます。削除されたレコードはキャプチャーされないことに注意してください。

機能¶

MySQL Source Connector には、以下の機能があります。

トピックの自動作成: このコネクターは、命名規則

<topic.prefix><tableName>を使用して自動的に Kafka トピックを作成します。テーブルの作成にはtopic.creation.default.partitions=1プロパティおよびtopic.creation.default.replication.factor=3プロパティが使用されます。挿入モード:

timestamp モードは、データベースの詳細を入力するときにタイムスタンプ列を指定した場合にのみ使用可能です。

timestamp+incrementing モードは、データベースの詳細を入力するときにタイムスタンプ列と増分列の両方を指定した場合に使用可能です。

重要

タイムスタンプ列を Null 許容にすることはできません。

データベースの認証: パスワード認証を使用します。

SSL のサポート: 一方向 SSL をサポートします。

データフォーマット: このコネクターは、Avro、JSON スキーマ、Protobuf、または JSON(スキーマレス)の出力データをサポートします。スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

厳選された構成プロパティ:

db.timezonepoll.interval.msbatch.max.rowstimestamp.delay.interval.mstopic.prefixschema.pattern

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

制限¶

以下の情報を確認してください。

- コネクターの制限事項については、MySQL Source Connector の制限事項を参照してください。

- 1 つ以上の Single Message Transforms(SMT)を使用する場合は、「SMT の制限」を参照してください。

- Confluent Cloud Schema Registry を使用する場合は、「スキーマレジストリ Enabled Environments」を参照してください。

クイックスタート¶

このクイックスタートを使用して、Confluent Cloud MySQL Source Connector の利用を開始することができます。このクイックスタートでは、コネクターを選択してから、MySQL データベースの既存データのスナップショットをキャプチャーするようにコネクターを構成する方法について説明します。コネクターは、それ以降に発生する行レベルの変更をすべてモニタリングして記録するようになります。

- 前提条件

アマゾンウェブサービス (AWS)、Microsoft Azure (Azure)、または Google Cloud Platform (GCP)上の Confluent Cloud クラスターへのアクセスを許可されていること。

Confluent CLI がインストールされ、クラスター用に構成されていること。「Confluent CLI のインストール」を参照してください。

このコネクターは、命名規則

<topic.prefix><tableName>を使用して自動的に Kafka トピックを作成します。テーブルの作成にはtopic.creation.default.partitions=1プロパティおよびtopic.creation.default.replication.factor=3プロパティが使用されます。特定の設定を指定してトピックを作成する場合は、このコネクターを実行する前にトピックを作成しておいてください。スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

Make sure your connector can reach your service. Consider the following before running the connector:

- Depending on the service environment, certain network access limitations may exist. See ネットワークアクセス for details.

- To use static egress IPs, see 静的なエグレス IP アドレス. For additional managed connector networking details, see Networking and DNS Considerations.

- Do not include

jdbc:xxxx://in the connection hostname property. An example of a connection hostname property isdatabase.example.endpoint.com. For example,mydatabase.abc123ecs2.us-west.rds.amazonaws.com. - Clients from Azure Virtual Networks are not allowed to access the server by default. Please ensure your Azure Virtual Network is correctly configured and that Allow access to Azure Services is enabled.

- See your specific cloud platform documentation for how to configure security rules for your VPC.

タイムスタンプ列を Null 許容にすることはできません。

インバウンドトラフィックを開く¶

MySQL Source Connector for Azure を作成する前に、データベースのタイムゾーン を設定しておく必要があります。詳細については「タイムゾーンパラメーターを使用する」を参照してください。

スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

- Kafka クラスターの認証情報。次のいずれかの方法で認証情報を指定できます。

- 既存の サービスアカウント のリソース ID を入力する。

- コネクター用の Confluent Cloud サービスアカウント を作成します。「サービスアカウント」のドキュメントで、必要な ACL エントリを確認してください。一部のコネクターには固有の ACL 要件があります。

- Confluent Cloud の API キーとシークレットを作成する。キーとシークレットを作成するには、confluent api-key create を使用するか、コネクターのセットアップ時に Cloud Console で直接 API キーとシークレットを自動生成します。

Confluent Cloud Console の使用¶

ステップ 1: Confluent Cloud クラスターを起動します。¶

インストール手順については、「Quick Start for Confluent Cloud」を参照してください。

ステップ 2: コネクターを追加します。¶

左のナビゲーションメニューの Data integration をクリックし、Connectors をクリックします。クラスター内に既にコネクターがある場合は、+ Add connector をクリックします。

ステップ 4: 接続をセットアップします。¶

以下を実行して、Continue をクリックします。

注釈

- すべての 前提条件 を満たしていることを確認してください。

- アスタリスク( * )は必須項目であることを示しています。

コネクターの 名前 を入力します。

Kafka Cluster credentials で Kafka クラスターの認証情報の指定方法を選択します。サービスアカウントのリソース ID を選択するか、API キーとシークレットを入力できます(または、Cloud Console でこれらを生成します)。

topic prefix にトピックのプレフィックスを入力します。このコネクターは、命名規則

<topic.prefix><tableName>を使用して自動的に Kafka トピックを作成します。テーブルの作成にはtopic.creation.default.partitions=1プロパティおよびtopic.creation.default.replication.factor=3プロパティが使用されます。特定の設定を指定してトピックを作成する場合は、このコネクターを実行する前にトピックを作成しておいてください。connection details にデータベース接続の詳細情報を追加します。

SSL mode でオプションが設定されない場合は、デフォルトオプションの

preferが有効になります。preferが有効の場合、コネクターは、データベースサーバーに対して暗号化された接続の使用を試みます。オプションには、次のものがあります。preferおよびrequire: コネクターは、セキュアな(暗号化された)接続を使用します。セキュアな接続を確立できない場合、コネクターは失敗します。これらのモードでは、認証機関(CA)検証は行われません。verify-ca: このオプションはrequireと似ていますが、構成された認証機関(CA)の証明書に対するサーバー TLS 証明書の検証も実行します。一致する有効な CA 証明書が見つからない場合には、エラーになります。verify-full:verify-caと似ていますが、接続試行先ホストに対するサーバー証明書の突き合わせの検証も実行します。- CA 情報を含むトラストストアファイルをアップロードするには、Trust store ボタンを使用します。Truststore password の追加が必要です。

Database details に、データベースについての詳細情報を追加します。フィールドの選択について詳しくは、以下の注意事項を参照してください。

- timestamp モードを有効にするには、Timestamp column name に入力します。このモードでは、新規行と変更行を検出するために、タイムスタンプ(またはタイムスタンプと同様の)列が使用されます。これにより、各書き込みにより列が更新され、値が単調に増加することが保証されています。ただし、必ずしも一意ではありません。

- timestamp+incrementing モードを有効にするには、Timestamp column name と Incrementing column name の両方に入力します。このモードでは、新規行および変更行を検出するタイムスタンプ列と、アップデートを表すためにグローバルに一意の ID を提供する、厳密に増分していく増分列の 2 つの列が使用されます。これによって、確実に一意のストリームオフセットを各行に割り当てることができます。

- デフォルトでは、コネクターはソースデータベースからタイプ TABLE のテーブルのみを検出します。1 つまたは複数のテーブルを結合して作成された仮想テーブルを検出するには、VIEW を使用します。短縮名または一時的な名前のテーブルには、ALIAS を使用します。

- データベースのスキーマパターンを定義するには、データベースからテーブルメタデータをフェッチするためのスキーマパターンを Schema pattern に入力する必要があります。

""の場合は、スキーマを使用しないテーブルのテーブルメタデータが取得されます。null(デフォルト)の場合、検索の絞り込みにスキーマ名は使用されず、スキーマに関係なくすべてのテーブルメタデータがフェッチされます。

Output Kafka record value のフォーマット(コネクターから送られるデータ)を AVRO、JSON_SR(JSON スキーマ)、PROTOBUF、JSON(スキーマレス)から選択します。スキーマベースのメッセージフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、有効なスキーマが Schema Registry に存在する必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

このコネクターで使用する タスク の数を入力します。詳しくは、コネクターの制限事項 を参照してください。

Transforms and Predicates: 詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。

すべてのプロパティの値と定義については、「構成プロパティ」を参照してください。

ステップ 5: コネクターを起動します。¶

実行中の構成をプレビューして、接続の詳細情報を確認します。プロパティの構成に問題がないことが確認できたら、Launch をクリックします。

ちなみに

コネクターの出力のプレビューについては、「コネクターのデータプレビュー」を参照してください。

ステップ 7: Kafka トピックを確認します。¶

コネクターが実行中になったら、メッセージが Kafka トピックに取り込まれていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。

Confluent CLI の使用¶

以下の手順に従うと、Confluent CLI を使用してコネクターをセットアップし、実行できます。

注釈

- すべての 前提条件 を満たしていることを確認してください。

- コマンド例では Confluent CLI バージョン 2 を使用しています。詳細については、「Confluent CLI v2 への移行 <https://docs.confluent.io/confluent-cli/current/migrate.html#cli-migrate>`__」を参照してください。

ステップ 2: コネクターの必須の構成プロパティを表示します。¶

以下のコマンドを実行して、コネクターの必須プロパティを表示します。

confluent connect plugin describe <connector-catalog-name>

例:

confluent connect plugin describe MySqlSource

出力例:

Following are the required configs:

connector.class

name

kafka.auth.mode

kafka.api.key

kafka.api.secret

topic.prefix

connection.host

connection.port

connection.user

connection.password

db.name

ssl.mode

table.whitelist

timestamp.column.name

output.data.format

tasks.max

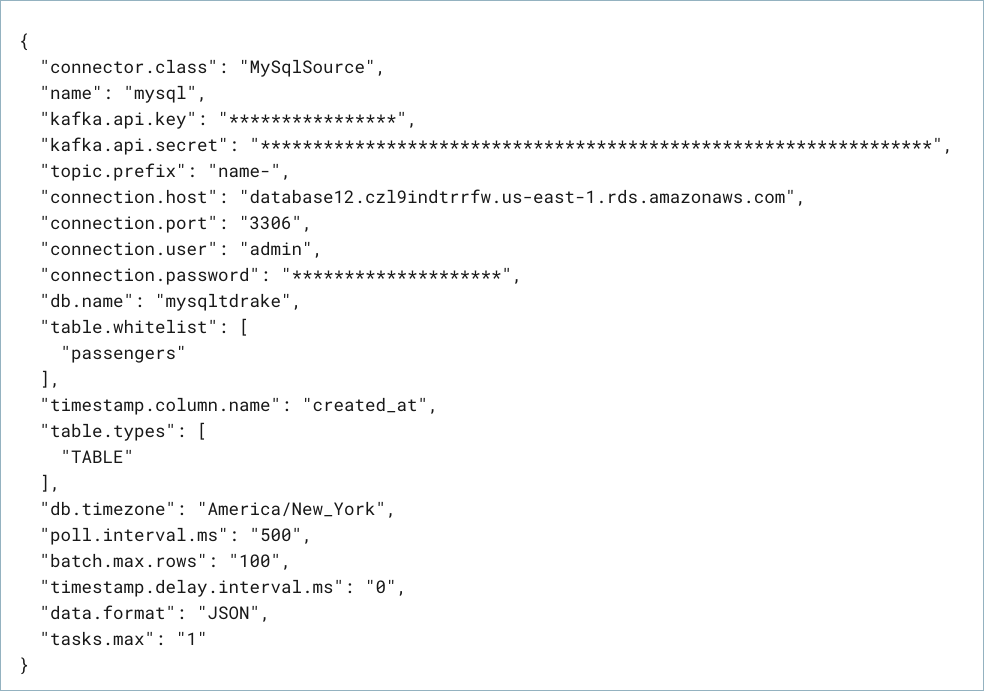

ステップ 3: コネクターの構成ファイルを作成します。¶

コネクター構成プロパティを含む JSON ファイルを作成します。以下の例は、コネクターの必須プロパティを示しています。

{

"name" : "confluent-mysql-source",

"connector.class": "MySqlSource",

"kafka.auth.mode": "KAFKA_API_KEY",

"kafka.api.key": "<my-kafka-api-key>",

"kafka.api.secret" : "<my-kafka-api-secret>",

"topic.prefix" : "mysql_",

"connection.host" : "<my-database-endpoint>",

"connection.port" : "3306",

"connection.user" : "<database-username>",

"connection.password": "<database-password>",

"ssl.mode": "prefer",

"db.name": "mysql-test",

"table.whitelist": "passengers",

"timestamp.column.name": "created_at",

"output.data.format": "JSON",

"db.timezone": "UCT",

"tasks.max" : "1"

}

以下のプロパティ定義に注意してください。

"name": 新しいコネクターの名前を設定します。"connector.class": コネクターのプラグイン名を指定します。

"kafka.auth.mode": 使用するコネクターの認証モードを指定します。オプションはSERVICE_ACCOUNTまたはKAFKA_API_KEY(デフォルト)です。API キーとシークレットを使用するには、構成プロパティkafka.api.keyとkafka.api.secretを構成例(前述)のように指定します。サービスアカウント を使用するには、プロパティkafka.service.account.id=<service-account-resource-ID>に リソース ID を指定します。使用できるサービスアカウントのリソース ID のリストを表示するには、次のコマンドを使用します。confluent iam service-account list

例:

confluent iam service-account list Id | Resource ID | Name | Description +---------+-------------+-------------------+------------------- 123456 | sa-l1r23m | sa-1 | Service account 1 789101 | sa-l4d56p | sa-2 | Service account 2

"topic.prefix": トピックのプレフィックスを入力します。このコネクターは、命名規則<topic.prefix><tableName>を使用して自動的に Kafka トピックを作成します。テーブルの作成にはtopic.creation.default.partitions=1プロパティおよびtopic.creation.default.replication.factor=3プロパティが使用されます。特定の設定を指定してトピックを作成する場合は、このコネクターを実行する前にトピックを作成しておいてください。ssl.modeプロパティの使用法に関する情報を以下に示します。ssl.modeがコネクター構成に追加されない場合は、デフォルトオプションのpreferが有効になります。preferが有効の場合、コネクターは、データベースサーバーに対して暗号化された接続の使用を試みます。preferおよびrequire: セキュアな(暗号化された)接続を使用します。セキュアな接続を確立できない場合、コネクターは失敗します。これらのモードでは、認証機関(CA)検証は行われません。verify-ca:requireと似ていますが、構成された認証機関(CA)の証明書に対するサーバー TLS 証明書の検証も実行します。一致する有効な CA 証明書が見つからない場合には、エラーになります。verify-full:verify-caと似ていますが、接続試行先ホストに対するサーバー証明書の突き合わせの検証も実行します。

verify-caまたはverify-fullを選択した場合は、プロパティssl.rootcertfileを使用して、プロパティ値のテキスト証明書ファイルのコンテンツを追加します。たとえば、"ssl.rootcertfile": "<certificate-text>"のようになります。timestamp.column.nameおよびincrementing.column.nameプロパティの使用法に関する情報を以下に示します。- timestamp モードを有効にするには、

timestamp.column.nameに入力します。このモードでは、新規行と変更行を検出するために、タイムスタンプ(またはタイムスタンプと同様の)列が使用されます。これにより、各書き込みにより列が更新され、値が単調に増加することが保証されています。ただし、必ずしも一意ではありません。 - timestamp+incrementing モードを有効にするには、

timestamp.column.nameとIncrementing.column.nameの両方に入力します。このモードでは 2 つの列が使用されます。新規行および変更行を検出するタイムスタンプ列と、アップデートに対してグローバルに一意の ID を提供して厳密に増加する列です。これによって、確実に一意のストリームオフセットを各行に割り当てることができます。デフォルトでは、コネクターはソースデータベースからタイプTABLEのtable.typesのみを検出します。1 つまたは複数のテーブルを結合して作成された仮想テーブルを検出するには、VIEWを入力します。短縮名または一時的な名前のテーブルには、ALIASを入力します。

- timestamp モードを有効にするには、

データベースのスキーマパターンを定義するには、データベースからテーブルメタデータをフェッチするために

Schema patternプロパティを入力する必要があります。""の場合は、スキーマを使用しないテーブルのテーブルメタデータが取得されます。null(デフォルト)の場合、検索の絞り込みにスキーマ名は使用されず、スキーマに関係なくすべてのテーブルメタデータがフェッチされます。"output.data.format": Kafka 出力レコード値のフォーマット(コネクターから送られるデータ)を設定します。指定可能なエントリは、AVRO、JSON_SR、PROTOBUF、または JSON です。スキーマベースのメッセージフォーマット(たとえば、Avro、JSON_SR(JSON スキーマ)、および Protobuf)を使用するには、Confluent Cloud Schema Registry を構成しておく必要があります。"db.timezone": データベースのタイムゾーンを指定します。任意の有効なデータベースのタイムゾーンを指定できます。デフォルトは UTC です。詳細については、こちらの データベースのタイムゾーンのリスト を参照してください。

Single Message Transforms: CLI を使用する SMT の追加の詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。

すべてのプロパティの値と定義については、「構成プロパティ」を参照してください。

ステップ 4: プロパティファイルを読み込み、コネクターを作成します。¶

以下のコマンドを入力して、構成を読み込み、コネクターを起動します。

confluent connect create --config <file-name>.json

例:

confluent connect create --config mysql-source.json

出力例:

Created connector confluent-mysql-source lcc-ix4dl

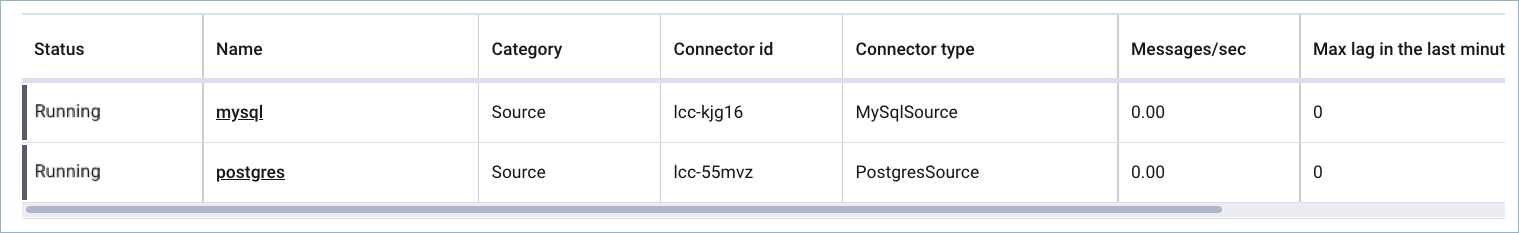

ステップ 5: コネクターのステータスを確認します。¶

以下のコマンドを入力して、コネクターのステータスを確認します。

confluent connect list

出力例:

ID | Name | Status | Type

+-----------+------------------------+---------+-------+

lcc-ix4dl | confluent-mysql-source | RUNNING | source

ステップ 6: Kafka トピックを確認します。¶

コネクターが実行中になったら、メッセージが Kafka トピックに取り込まれていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

構成プロパティ¶

このコネクターでは、以下のコネクター構成プロパティを使用します。

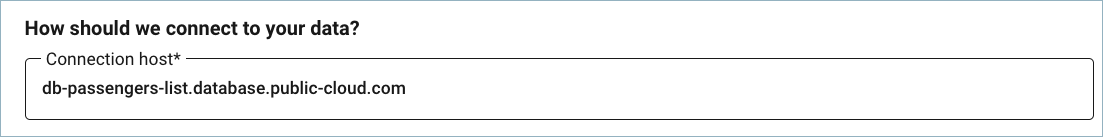

データへの接続方法(How should we connect to your data?)¶

nameコネクターの名前を設定します。

- 型: string

- 指定可能な値: 最大 64 文字の文字列

- 重要度: 高

Kafka クラスターの認証情報(Kafka Cluster credentials)¶

kafka.auth.modeKafka の認証モード。KAFKA_API_KEY または SERVICE_ACCOUNT を指定できます。デフォルトは KAFKA_API_KEY モードです。

- 型: string

- デフォルト: KAFKA_API_KEY

- 指定可能な値: KAFKA_API_KEY、SERVICE_ACCOUNT

- 重要度: 高

kafka.api.key- 型: password

- 重要度: 高

kafka.service.account.idKafka クラスターとの通信用の API キーを生成するために使用されるサービスアカウント。

- 型: string

- 重要度: 高

kafka.api.secret- 型: password

- 重要度: 高

テーブル名のプレフィックスの付け方(How do you want to prefix table names?)¶

topic.prefixデータのパブリッシュ先である Apache Kafka® トピックの名前を生成するためにテーブル名の先頭に付けるプレフィックス。

- 型: string

- 重要度: 高

データベースへの接続方法(How should we connect to your database?)¶

connection.hostDepending on the service environment, certain network access limitations may exist. Make sure the connector can reach your service. Do not include jdbc:xxxx:// in the connection hostname property (e.g. database-1.abc234ec2.us-west.rds.amazonaws.com).

- 型: string

- 重要度: 高

connection.portJDBC 接続ポート。

- 型: int

- 指定可能な値: [0,...,65535]

- 重要度: 高

connection.userJDBC 接続ユーザー。

- 型: string

- 重要度: 高

connection.passwordJDBC 接続パスワード。

- 型: password

- 重要度: 高

db.nameJDBC データベース名。

- 型: string

- 重要度: 高

ssl.modeデータベースへの接続に使用する必要がある SSL モードを指定します。prefer および require では、接続を暗号化できますが、サーバーの証明書の検証は行われません。verify-ca および verify-full では、SSL CA 証明書情報が含まれるファイルを指定する必要があります。サーバーの証明書は検証され、これらの認証機関のうちの 1 つで署名されます。verify-ca では、信頼できる CA によって発行されたサーバー証明書であることが検証されます。verify-full では、信頼できる CA によって発行されたサーバー証明書であること、およびサーバーのホスト名が証明書と一致していることが検証されます。クライアント認証は実行されません。

- 型: string

- デフォルト: prefer

- 重要度: 高

ssl.truststorefileサーバー CA 証明書情報が含まれるトラストストア。ssl モードとして verify-ca または verify-full を使用する場合にのみ必要になります。

- 型: password

- デフォルト: [hidden]

- 重要度: 低

ssl.truststorepasswordサーバー CA 証明書情報が含まれるトラストストアのパスワード。ssl モードとして verify-ca または verify-full を使用する場合にのみ必要になります。

- 型: password

- デフォルト: [hidden]

- 重要度: 低

データベースの詳細(Database details)¶

table.whitelistコピーに含めるテーブルのリスト。複数のテーブルを指定するには、コンマ区切りのリストを使用します(例: "User, Address, Email")。

- 型: list

- 重要度: 中

timestamp.column.nameCOALESCE SQL 関数を使用して新規行または変更行を検出するための 1 つ以上のタイムスタンプ列のコンマ区切りリスト。ポーリングのたびに、最初の null 以外のタイムスタンプ値が前回見つかった最大のタイムスタンプ値より大きい行が検出されます。少なくとも 1 つの列は null 許容でないことが必要です。

- 型: list

- 重要度: 中

incrementing.column.name新しい行の検出に使用する厳密な増分列の名前。空の値は、自動増分列を探すことによって、列を自動検出する必要があることを示します。この列を null 許容にすることはできません。

- 型: string

- デフォルト: ""

- 重要度: 中

table.typesデフォルトでは、JDBC コネクターはソースデータベースからタイプ TABLE のテーブルのみを検出します。この構成では、抽出するテーブルタイプをコンマ区切りのリストで指定できます。

- 型: list

- デフォルト: TABLE

- 重要度: 中

schema.patternデータベースからテーブルメタデータをフェッチするためのスキーマパターン。

- 型: string

- 重要度: 高

db.timezoneコネクターで時間ベースの基準を使用してクエリを実行する場合に使用する JDBC タイムゾーンの名前。デフォルトは UTC です。

- 型: string

- デフォルト: UTC

- 重要度: 中

numeric.mappingNUMERIC 値を精度およびオプションでスケールに基づいて、整数型または小数型にマップします。すべての NUMERIC 列を Connect の DECIMAL 論理型で表す場合は、

noneを使用します。NUMERIC 列を、列の精度とスケールに基づいて、Connect の INT8、INT16、INT32、INT64、または FLOAT64 にキャストする必要がある場合は、best_fitを使用します。上記の best_fit のプロパティに加えて、精度が失われる可能性があっても、スケールが指定された NUMERIC 列を常に Connect FLOAT64 型にキャストする必要がある場合は、best_fit_eager_doubleを使用します。列の精度のみに基づいて(列のスケールが 0 であることを前提として)NUMERIC 列をマップするには、precision_onlyを使用します。noneオプションがデフォルトですが、Connect の DECIMAL 型はそのバイナリ表現にマップされるため、Avro のシリアル化の問題を招く可能性があり、多くの場合、最も適切なプリミティブ型にマップされるbest_fitが望ましい選択となります。- 型: string

- デフォルト: none

- 重要度: 低

timestamp.granularityDefine the granularity of the Timestamp column. CONNECT_LOGICAL (default):represents timestamp values using Kafka Connect built-in representations. NANOS_LONG: represents timestamp values as nanos since epoch. NANOS_STRING: represents timestamp values as nanos since epoch in string. NANOS_ISO_DATETIME_STRING: uses iso format

- 型: string

- Default: CONNECT_LOGICAL

- 重要度: 低

モード(Mode)¶

modeポーリングのたびにテーブルを更新するためのモード。BULK では、ポーリングのたびにテーブル全体の一括読み込みを実行します。TIMESTAMP では、タイムスタンプ(またはそれに準ずる)列を使用して、新規行と変更行を検出します。書き込みのたびに列が更新されること、および、値は単調増加しますが必ずしも一意ではないことが前提となっています。INCREMENTING では、各テーブルの厳密な増分列を使用して、新しい行のみを検出します。既存の行の変更または削除は検出されません。TIMESTAMP AND INCREMENTING では、新規および変更済み行を検出するタイムスタンプ列と、更新に対するグローバルに一意の ID を提供する厳密な増分列の 2 つの列を使用します。これにより、各行を一意のストリームオフセットに割り当てることができます。

- 型: string

- デフォルト: ""

- 重要度: 中

quote.sql.identifiersSQL ステートメントで、テーブル名、列名、その他の識別子をいつクォートするかを指定します。後方互換性を確保するため、デフォルト値は ALWAYS です。

- 型: string

- デフォルト: ALWAYS

- 指定可能な値: ALWAYS、NEVER

- 重要度: 中

transaction.isolation.modeIsolation level determines how transaction integrity is visible to other users and systems. DEFAULT: This is the default isolation level configured at the Database Server. READ_UNCOMMITTED: This is the lowest isolation level. At this level, one transaction may see dirty reads (that is, not-yet-committed changes made by other transactions). READ_COMMITTED: This level guarantees that any data read is already committed at the moment it is read. REPEATABLE_READ: In addition to the guarantees of the READ_COMMITTED level, this option also guarantees that any data read cannot change, if the transaction reads the same data again. However, phantom reads are possible. SERIALIZABLE: This is the highest isolation level. In addition to everything REPEATABLE_READ guarantees, it also eliminates phantom reads.

- 型: string

- Default: DEFAULT

- Valid Values: DEFAULT, READ_COMMITTED, READ_UNCOMMITTED, REPEATABLE_READ, SERIALIZABLE

- 重要度: 中

timestamp.initialタイムスタンプ基準を使用する最初のクエリで使用するエポックタイムスタンプ。値として -1 を指定すると、初期タイムスタンプに現在時刻が設定されます。指定しない場合、コネクターはすべてのデータを取得します。コネクターでソースオフセットが正常に記録されると、後で別の値に変更した場合もこのプロパティによる影響は発生しません。

- 型: long

- 指定可能な値: [-1,...]

- 重要度: 中

接続の詳細(Connection details)¶

poll.interval.ms各テーブルの新しいデータをポーリングする頻度(ミリ秒)。

- 型: int

- デフォルト: 5000(5 秒)

- 指定可能な値: [100,...]

- 重要度: 高

batch.max.rows新しいデータのポーリング時に単一のバッチに含める最大行数。この設定を使用して、コネクターの内部にバッファリングするデータの量を制限できます。

- 型: int

- デフォルト: 100

- 指定可能な値: [1,...,5000]

- 重要度: 低

timestamp.delay.interval.ms特定のタイムスタンプを持つ行が出現してからそれを結果に含めるまでに待機する時間。より早いタイムスタンプを持つトランザクションが完了できるように、遅延を追加できます。最初の実行では、現在の時刻から遅延を引いた時刻までの利用可能なすべての(タイムスタンプ 0 からの)レコードをフェッチします。その後の各実行では、最後のフェッチ時刻から、現在の時刻から遅延を引いた時刻までのデータを取得します。

- 型: int

- デフォルト: 0

- 指定可能な値: [0,...]

- 重要度: 高

出力メッセージ(Output messages)¶

output.data.formatKafka 出力レコード値のフォーマットを設定します。指定可能なエントリは、AVRO、JSON_SR、PROTOBUF、または JSON です。スキーマベースのメッセージフォーマット(AVRO、JSON_SR、PROTOBUF など)を使用する場合は、Confluent Cloud Schema Registry を構成しておく必要がある点に注意してください

- 型: string

- 重要度: 高

このコネクターのタスク数(Number of tasks for this connector)¶

tasks.max- 型: int

- 指定可能な値: [1,...]

- 重要度: 高

次のステップ¶

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。