重要

このページの日本語コンテンツは古くなっている可能性があります。最新の英語版コンテンツをご覧になるには、こちらをクリックしてください。

GitHub Source Connector for Confluent Cloud¶

注釈

Confluent Platform 用にコネクターをローカルにインストールする場合は、「GitHub Source Connector for Confluent Platform」を参照してください。

Kafka Connect GitHub Source Connector for Confluent Cloud は、GitHub から Apache Kafka® にメタデータを書き込むために使用されます。これには、リアルタイムの変更または履歴データの消費と、これらの Kafka トピックへの書き込みが含まれます。コネクターにより、GitHub API を通じて GitHub からデータがポーリングされ、Kafka レコードに変換された後、そのレコードが Kafka のトピックにプッシュされます。GitHub から得られた各レコードは、1 つの Kafka レコードに変換されます。

機能¶

GitHub Source Connector には、以下の機能があります。

- 少なくとも 1 回のデリバリー: コネクターによって、レコードが Kafka のトピックに少なくとも 1 回は配信されることが保証されます。

- API のレート制限の認識: API のレート制限を超えた場合、コネクターでは、GitHub からのレコードのフェッチが停止されます。API のレート制限がリセットされると、コネクターによるレコードのフェッチが再開されます。

- サポートされるデータフォーマット: このコネクターは、Avro、JSON スキーマ(JSON-SR)、Protobuf、および JSON(スキーマレス)出力フォーマットをサポートします。スキーマレジストリ ベースのフォーマット(Avro、JSON スキーマ、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

制限¶

以下の情報を確認してください。

- コネクターの制限事項については、GitHub Source Connector の制限事項を参照してください。

- 1 つ以上の Single Message Transforms(SMT)を使用する場合は、「SMT の制限」を参照してください。

- Confluent Cloud Schema Registry を使用する場合は、「スキーマレジストリ Enabled Environments」を参照してください。

注釈

GitHub API の制限により、コネクターでは 1 つのタスクのみサポートされます。

GitHub のリソース¶

GitHub コネクターは、次のリソースからのレコードのフェッチをサポートしています。

- assignees: 指定されたリポジトリにアサイン可能な人。詳細については、API のドキュメントの「アサインされた人」 を参照してください。

- collaborators: 指定されたリポジトリのコラボレータ。詳細については、API のドキュメントの「コラボレータ」 を参照してください。

- issues: すべての GitHub ステートの問題。詳細については、API のドキュメントの「問題」 を参照してください。

- comments: 問題のコメント。詳細については、API のドキュメントの「コメント」 を参照してください。

- commits: master ブランチのコミット(のみ)。詳細については、API のドキュメントの「コミット」 を参照してください。

- pull_requests: すべての GitHub ステートのプルリクエスト。詳細については、API のドキュメントの「Pulls」 を参照してください。

- releases: 指定されたリポジトリのリリース。詳細については、API のドキュメントの「リリース」 を参照してください。

- reviews: プルリクエストについてのレビュー。レビューは、プルリクエストとともにのみフェッチできます。詳細については、API のドキュメントの『Pulls』 を参照してください。

- review_comments: プルリクエストについてのレビューコメント。詳細については、API のドキュメントの『Pulls』 を参照してください。

- stargazers: 指定されたリポジトリに Star を付けた人。詳細については、API のドキュメントの「Star」 を参照してください。

クイックスタート¶

このクイックスタートを使用して、Confluent Cloud GitHub Source Connector の利用を開始することができます。このクイックスタートでは、コネクターを選択し、イベントをストリーミングするようにコネクターを構成するための基本的な方法について説明します。

- 前提条件

- アマゾンウェブサービス (AWS)、Microsoft Azure (Azure)、または Google Cloud Platform (GCP)上の Confluent Cloud クラスターへのアクセスを許可されていること。

- Confluent CLI がインストールされ、クラスター用に構成されていること。「Confluent CLI のインストール」を参照してください。

- スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。

- GitHub エンドポイントにアクセスするための認可と認証情報。

- ソースコネクターを作成する前に、Confluent Cloud クラスター上に Kafka トピックが 1 つ以上存在している必要があります。

Confluent Cloud Console の使用¶

ステップ 1: Confluent Cloud クラスターを起動します。¶

インストール手順については、「Quick Start for Confluent Cloud」を参照してください。

ステップ 2: コネクターを追加します。¶

左のナビゲーションメニューの Data integration をクリックし、Connectors をクリックします。クラスター内に既にコネクターがある場合は、+ Add connector をクリックします。

Step 4: Enter the connector details.¶

注釈

- すべての 前提条件 を満たしていることを確認してください。

- アスタリスク ( * ) は必須項目であることを示しています。

At the Add GitHub Source Connector screen, complete the following:

- Select the way you want to provide Kafka Cluster credentials. You can

choose one of the following options:

- Global Access: Allows your connector to access everything you have access to. With global access, connector access will be linked to your account. This option is not recommended for production.

- Granular access: Limits the access for your connector. You will be able to manage connector access through a service account. This option is recommended for production.

- Use an existing API key: Allows you to enter an API key and secret part you have stored. You can enter an API key and secret (or generate these in the Cloud Console).

- Click Continue.

Add the Amazon CloudWatch connection authentication details:

- GitHub Endpoint: The GitHub API root endpoint.

For example,

https://api.github.com. - GitHub Access Token: Used as the value of

Authorizationin HTTP requests.

For information about how to set these up, see Access Keys.

- GitHub Endpoint: The GitHub API root endpoint.

For example,

Click Continue.

Add the following details:

- Select the output record value format (data going to the Kafka topic): AVRO, JSON, JSON_SR (JSON Schema), or PROTOBUF. Schema Registry must be enabled to use a スキーマレジストリ-based format (for example, Avro, JSON Schema, or Protobuf). For additional information, see スキーマレジストリ Enabled Environments.

- GitHub Repositories: GitHub リポジトリ、またはリポジトリのコンマ区切りのリスト(

owner/repo-nameの形式)。たとえば、"apache/kafka, confluentinc/ksql"のようになります。 - GitHub Resources: One or more resources that the connector extracts and writes to Kafka. For details, see GitHub のリソース.

Show advanced configurations

Since: Records created or updated after this time will be processed by the connector. If left blank, the default time will be set to the time this connector is launched. Expected format is

yyyy- MM-dd'T'HH:mm:ssXoryyyy-MM-dd.Transforms and Predicates: For details, see the Single Message Transforms (SMT) documentation.

For all property values and definitions, see 構成プロパティ.

Click Continue.

Based on the number of topic partitions you select, you will be provided with a recommended number of tasks.

- To change the number of tasks, use the Range Slider to select the desired number of tasks.

- Click Continue.

Step 5: Check for records.¶

レコードが Kafka のトピックに生成されていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

Confluent CLI の使用¶

以下の手順に従うと、Confluent CLI を使用してコネクターをセットアップし、実行できます。

注釈

- すべての 前提条件 を満たしていることを確認してください。

- コマンド例では Confluent CLI バージョン 2 を使用しています。詳細については、「Confluent CLI v2 への移行 <https://docs.confluent.io/confluent-cli/current/migrate.html#cli-migrate>`__」を参照してください。

ステップ 2: コネクターの必須の構成プロパティを表示します。¶

以下のコマンドを実行して、コネクターの必須プロパティを表示します。

confluent connect plugin describe <connector-catalog-name>

例:

confluent connect plugin describe GithubSource

出力例:

Following are the required configs:

connector.class: GithubSource

name

kafka.auth.mode

kafka.api.key

kafka.api.secret

github.service.url

github.access.token

github.repositories

github.resources

output.data.format

tasks.max

ステップ 3: コネクターの構成ファイルを作成します。¶

コネクター構成プロパティを含む JSON ファイルを作成します。以下の例は、コネクターの必須プロパティを示しています。その他の構成プロパティの値と詳細については、「構成プロパティ」を参照してください。

{

"connector.class": "GithubSource",

"name": "GithubSource_0",

"kafka.auth.mode": "KAFKA_API_KEY",

"kafka.api.key": "<my-kafka-api-key>",

"kafka.api.secret": "<my-kafka-api-secret>",

"github.service.url": "https://api.github.com`",

"github.access.token": "*********************************",

"github.repositories": "<owner/repo-name>",

"github.resources": "pull_requests, reviews, review_comments",

"output.data.format": "AVRO",

"tasks.max": "1",

}

以下のプロパティ定義に注意してください。

"connector.class": コネクターのプラグイン名を指定します。"name": 新しいコネクターの名前を設定します。

"kafka.auth.mode": 使用するコネクターの認証モードを指定します。オプションはSERVICE_ACCOUNTまたはKAFKA_API_KEY(デフォルト)です。API キーとシークレットを使用するには、構成プロパティkafka.api.keyとkafka.api.secretを構成例(前述)のように指定します。サービスアカウント を使用するには、プロパティkafka.service.account.id=<service-account-resource-ID>に リソース ID を指定します。使用できるサービスアカウントのリソース ID のリストを表示するには、次のコマンドを使用します。confluent iam service-account list

例:

confluent iam service-account list Id | Resource ID | Name | Description +---------+-------------+-------------------+------------------- 123456 | sa-l1r23m | sa-1 | Service account 1 789101 | sa-l4d56p | sa-2 | Service account 2

GitHub 接続の詳細情報を入力します。

"github.service.url": GitHub API ルートエンドポイント。デフォルトはhttps://api.github.comに設定されています。"github.repositories": GitHub リポジトリ、またはリポジトリのコンマ区切りのリスト(owner/repo-nameの形式)。たとえば、"apache/kafka, confluentinc/ksql"のようになります。"github.resources": コネクターで抽出され Kafka に書き込まれる 1 つまたは複数のリソース。詳細については、「GitHub のリソース」を参照してください。

"output.data.format": 出力データフォーマット( Kafka トピックに送られるデータ)として AVRO、JSON_SR(JSON スキーマ)、PROTOBUF、または JSON(スキーマレス)を入力します。スキーマレジストリ ベースのフォーマット(Avro、JSON_SR(JSON スキーマ)、Protobuf など)を使用するには、Schema Registry を有効にしておく必要があります。詳細については、「スキーマレジストリ Enabled Environments」を参照してください。"tasks.max": このコネクターで使用する タスク の数を入力します。GitHub API の制限により、コネクターでは 1 つのタスクのみサポートされます。

- Transforms and Predicates: 詳細については、Single Message Transforms(SMT) のドキュメントを参照してください。

すべてのプロパティの値と説明については、「構成プロパティ」を参照してください。

ステップ 4: プロパティファイルを読み込み、コネクターを作成します。¶

以下のコマンドを入力して、構成を読み込み、コネクターを起動します。

confluent connect create --config <file-name>.json

例:

confluent connect create --config github-source-config.json

出力例:

Created connector GithubSource_0 lcc-do6vzd

ステップ 5: コネクターのステータスを確認します。¶

以下のコマンドを入力して、コネクターのステータスを確認します。

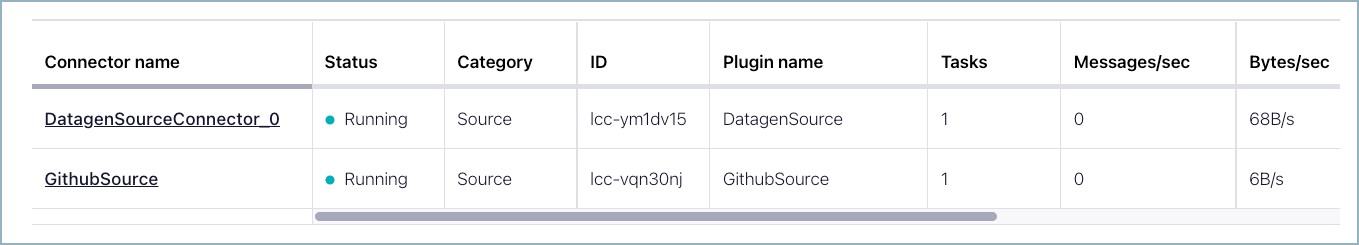

confluent connect list

出力例:

ID | Name | Status | Type | Trace

+------------+--------------------------+---------+--------+-------+

lcc-do6vzd | GithubSource_0 | RUNNING | source | |

ステップ 6: レコードを確認します。¶

レコードが Kafka のトピックに生成されていることを確認します。

Connect 用の Confluent Cloud API の使用に関する詳細とサンプルについては、「Confluent Cloud API for Connect」セクションを参照してください。

構成プロパティ¶

このコネクターでは、以下のコネクター構成プロパティを使用します。

データへの接続方法(How should we connect to your data?)¶

nameコネクターの名前を設定します。

- 型: string

- 指定可能な値: 最大 64 文字の文字列

- 重要度: 高

Kafka クラスターの認証情報(Kafka Cluster credentials)¶

kafka.auth.modeKafka の認証モード。KAFKA_API_KEY または SERVICE_ACCOUNT を指定できます。デフォルトは KAFKA_API_KEY モードです。

- 型: string

- デフォルト: KAFKA_API_KEY

- 指定可能な値: KAFKA_API_KEY、SERVICE_ACCOUNT

- 重要度: 高

kafka.api.key- 型: password

- 重要度: 高

kafka.service.account.idKafka クラスターとの通信用の API キーを生成するために使用されるサービスアカウント。

- 型: string

- 重要度: 高

kafka.api.secret- 型: password

- 重要度: 高

データ送信先のトピック名のパターン(Which topic name pattern do you want to send data to?)¶

topic.name.patternトピック名に使用するパターン。

${resourceName}リテラルは各リソース名に置き換えられます。- 型: string

- デフォルト: ${resourceName}

- 重要度: 高

How should we connect to GitHub?¶

github.service.urlGitHub API ルートエンドポイント。(例: https://api.github.com)。

- 型: string

- 重要度: 中

github.access.token指定したトークンが、HTTP リクエストの「Authorization」ヘッダーの値として使用されます。

- 型: password

- 重要度: 高

github.repositoriesThe GitHub repositories to read from in the form of owner/repo-name. Ex: apache/kafka, apache/superset

- 型: list

- 重要度: 高

github.resources抽出されて Kafka に書き込まれるリソース。

- 型: list

- 重要度: 高

github.sinceこの時刻以降に作成または更新されたレコードがコネクターによる処理の対象となります。空白にした場合は、デフォルトの時刻として、このコネクターの起動時刻に設定されます。想定されているフォーマットは yyyy-MM-dd'T'HH:mm:ssX または yyyy-MM-dd です。

- 型: string

- 重要度: 高

接続の詳細(Connection details)¶

max.batch.size一度に返され、Kafka に書き込まれる最大レコード数。

- 型: int

- デフォルト: 100

- 重要度: 低

max.in.flight.requests一度に送信可能な最大リクエスト数。

- 型: int

- デフォルト: 10

- 重要度: 低

max.poll.interval.ms変更または更新されたエンティティをフェッチするリクエストの間隔(ミリ秒)。

- 型: long

- デフォルト: 3000(3 秒)

- 重要度: 低

request.interval.ms更新されたレコードをチェックするまでの待ち時間(ミリ秒)。

- 型: long

- デフォルト: 15000(15 秒)

- 重要度: 低

max.retriesエラー時に再試行する最大回数。これを超えるとタスクは失敗します。

- 型: int

- デフォルト: 10

- 重要度: 低

retry.backoff.msエラーの後、再試行するまでの時間(ミリ秒)。

- 型: long

- デフォルト: 3000(3 秒)

- 重要度: 低

出力メッセージ(Output messages)¶

output.data.formatKafka 出力レコード値のフォーマットを設定します。指定可能なエントリは、AVRO、JSON_SR、PROTOBUF、または JSON です。スキーマベースのメッセージフォーマット(AVRO、JSON_SR、PROTOBUF など)を使用する場合は、Confluent Cloud Schema Registry を構成しておく必要がある点に注意してください

- 型: string

- 重要度: 高

このコネクターのタスク数(Number of tasks for this connector)¶

tasks.max- 型: int

- 指定可能な値: [1,...]

- 重要度: 高

次のステップ¶

参考

フルマネージド型の Confluent Cloud コネクターが Confluent Cloud ksqlDB でどのように動作するかを示す例については、「Cloud ETL のデモ」を参照してください。この例では、Confluent CLI を使用して Confluent Cloud のリソースを管理する方法についても説明しています。